Cómo "piensa" una IA — sin jerga, para humanos

Una mañana cualquiera en tu teléfono

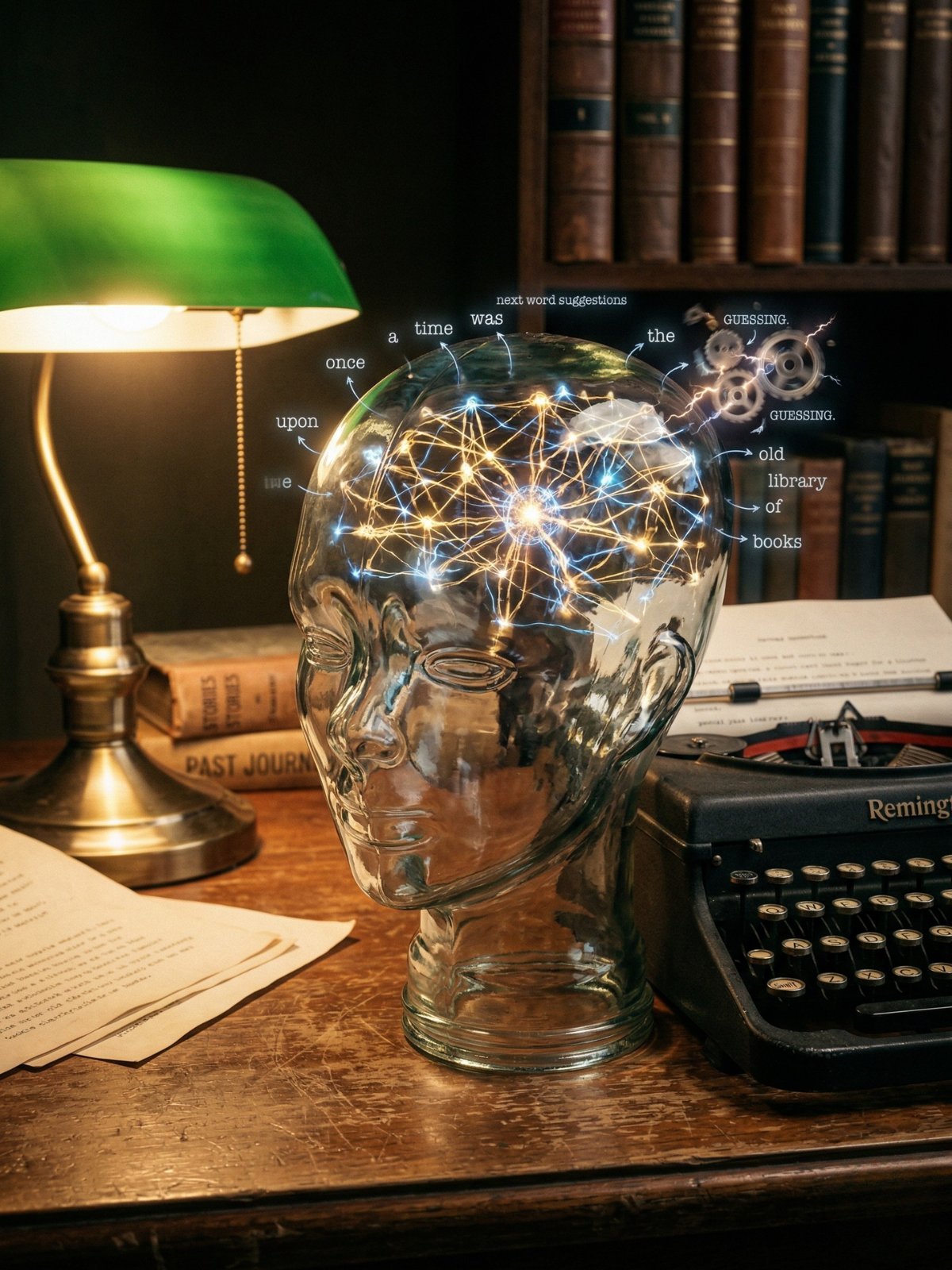

Abrís WhatsApp. Escribís: "Hola, ¿cómo…". El teclado te sugiere "estás". No piensa. Predice.

Una IA generativa es lo mismo, pero en escala gigantesca. Se llama Large Language Model, y es una máquina de predecir palabras entrenada con tanto texto que sus predicciones suenan inteligentes.

Cómo se entrenó: 1. Los creadores le dieron 500 mil millones de palabras — libros, artículos, código, todo internet. 2. La IA leyó eso y aprendió correlaciones. No "entendió" conceptos. Aprendió: después de "el gato" viene probablemente "está", "salta", "maúlla" — casi nunca "estudia matemáticas". 3. Ese aprendizaje quedó congelado en pesos neurales — números que viven en conexiones entre neuronas artificiales simuladas.

Cómo predice en tiempo real

Vos escribís: "Analiza este balance financiero y…". La IA: 1. Convierte cada palabra en números (embeddings). 2. Pasa esos números por capas de multiplicaciones y sumas (redes neuronales). 3. Calcula un número para cada palabra posible del diccionario. 4. El número más alto gana: esa es la próxima palabra. 5. Esa palabra entra de nuevo. Predicción de la siguiente. Y otra vez.

Así genera párrafos enteros, palabra por palabra.

¿Y a vos qué te cambia?

Significa que la IA no entiende verdaderamente el significado. No sabe qué es un balance. No sabe si tus números son correctos. Lo que hace es: "después de 'analiza este balance financiero' viene probablemente 'ingresos', 'gastos', 'mejoraste tu margen'…". Palabras estadísticamente plausibles.

Por eso: – Funciona bien con tareas donde los patrones están claros (escribir un email, resumir un texto, explicar un concepto). El patrón está en sus 500 mil millones de palabras de entrenamiento. – Falla cuando necesita verdad nueva (cuál es el precio de hoy, quién es tu cliente específico, qué pasó la semana pasada). Eso no está en su entrenamiento, así que adivina. – Confunde confianza con precisión. Si sus datos tenían información falsa, la repetirá con la misma seguridad que información verdadera.

Sin contexto que le des vos, predice genéricamente. Con contexto — tu negocio, tu voz, lo que querés resolver — sus predicciones se ajustan.

Ese es el punto del Método CAFÉ: si le das Contexto claro, Acción concreta, Formato preciso y Estilo definido, la IA tiene mucho más material para trabajar. Sus predicciones salen tuyas.

Lo que muchos no ven

Mucha gente piensa que la IA tiene "conocimiento adentro" o una "comprensión mágica del mundo". No tiene nada de eso. Tiene números. Cuando vos hacés una pregunta, esos números se rearreglan de formas que probaron funcionar bien en casos similares.

Es como un chef que leyó 50 mil recetas pero nunca probó la comida. Sabe dónde va la sal porque está en todos los textos. Pero no sabe cómo se ve una torta al horno si nunca la vio.

Para seguir leyendo

Si querés entender por qué Claude diferencia bien entre lo que sabe y lo que no sabe (mientras otros modelos alucinan), eso es un artículo distinto. La pista: es arquitectura, calibración y cómo se entrena el modelo.

Mientras tanto: la próxima vez que uses una IA, recordá que no piensa. Predice. Dale pistas claras (contexto), tarea concreta (acción), forma específica (formato) y sonido tuyo (estilo). Así sus predicciones te sirven para verdad.

Cómo "piensa" una IA — sin jerga, para humanos

Tu teléfono ya hace esto todos los días: cuando escribís un mensaje, el teclado te sugiere la próxima palabra. Escritura → predicción.

Una IA es exactamente eso, pero amplificado mil millones de veces. Se llama predicción de tokens, y es literalmente todo lo que hace. La IA leyó 500 mil millones de textos (libros, artículos, código, conversaciones) y aprendió: después de "Buenos días" viene probablemente "cómo estás", no "hipopótamo".

Ese aprendizaje vive en los pesos — números invisibles en conexiones entre neuronas artificiales. Cuando vos escribís un prompt, la IA multiplica números sobre números sobre números, y el resultado es una palabra probable. Esa palabra entra de nuevo al sistema. Predice la siguiente. Y otra. Y otra.

¿Por qué funciona tan bien? Porque leyó absolutamente todo. Patrones para escribir emails, explicar ciencia, contar historias, responder críticas. La IA no entiende nada (un humano sí). Reconoce patrones estadísticos — sofisticación matemática, nada más.

Entonces, ¿por qué a veces miente?

Porque confunde probabilidad con verdad. Si entrenaste una IA con mil artículos de historia falsa, aprenderá esos patrones y los predecirá con la misma confianza que verdades reales. Para la máquina, son solo números que funcionan.

Sin contexto tuyo, la IA predice genéricamente. Con contexto (tu negocio, tu voz, tu problema específico), ajusta sus predicciones. Por eso el Método CAFÉ funciona: le das contexto claro, acción específica, formato definido y estilo tuyo. La IA tiene más pistas para predecir mejor.

Lo que tenés que recordar: - La IA no piensa, predice. - Funciona porque leyó enormemente. - Si querés resultados tuyos, dale contexto propio.

Para arrancar de verdad: cuando uses una IA, imaginá que no entiende absolutamente nada. Es un predictor brutal. Dale instrucciones claras, ejemplos reales, restricciones específicas. Así sus predicciones salen tuyas, no genéricas.

Cómo "piensa" una IA — sin jerga, para humanos

Una mañana cualquiera en tu teléfono

Abrís WhatsApp. Escribís: "Hola, ¿cómo…". El teclado te sugiere "estás". No piensa. Predice.

Una IA generativa es lo mismo, pero en escala gigantesca. Se llama Large Language Model, y es una máquina de predecir palabras entrenada con tanto texto que sus predicciones suenan inteligentes.

Cómo se entrenó: 1. Los creadores le dieron 500 mil millones de palabras — libros, artículos, código, todo internet. 2. La IA leyó eso y aprendió correlaciones. No "entendió" conceptos. Aprendió: después de "el gato" viene probablemente "está", "salta", "maúlla" — casi nunca "estudia matemáticas". 3. Ese aprendizaje quedó congelado en pesos neurales — números que viven en conexiones entre neuronas artificiales simuladas.

Cómo predice en tiempo real

Vos escribís: "Analiza este balance financiero y…". La IA: 1. Convierte cada palabra en números (embeddings). 2. Pasa esos números por capas de multiplicaciones y sumas (redes neuronales). 3. Calcula un número para cada palabra posible del diccionario. 4. El número más alto gana: esa es la próxima palabra. 5. Esa palabra entra de nuevo. Predicción de la siguiente. Y otra vez.

Así genera párrafos enteros, palabra por palabra.

¿Y a vos qué te cambia?

Significa que la IA no entiende verdaderamente el significado. No sabe qué es un balance. No sabe si tus números son correctos. Lo que hace es: "después de 'analiza este balance financiero' viene probablemente 'ingresos', 'gastos', 'mejoraste tu margen'…". Palabras estadísticamente plausibles.

Por eso: – Funciona bien con tareas donde los patrones están claros (escribir un email, resumir un texto, explicar un concepto). El patrón está en sus 500 mil millones de palabras de entrenamiento. – Falla cuando necesita verdad nueva (cuál es el precio de hoy, quién es tu cliente específico, qué pasó la semana pasada). Eso no está en su entrenamiento, así que adivina. – Confunde confianza con precisión. Si sus datos tenían información falsa, la repetirá con la misma seguridad que información verdadera.

Sin contexto que le des vos, predice genéricamente. Con contexto — tu negocio, tu voz, lo que querés resolver — sus predicciones se ajustan.

Ese es el punto del Método CAFÉ: si le das Contexto claro, Acción concreta, Formato preciso y Estilo definido, la IA tiene mucho más material para trabajar. Sus predicciones salen tuyas.

Lo que muchos no ven

Mucha gente piensa que la IA tiene "conocimiento adentro" o una "comprensión mágica del mundo". No tiene nada de eso. Tiene números. Cuando vos hacés una pregunta, esos números se rearreglan de formas que probaron funcionar bien en casos similares.

Es como un chef que leyó 50 mil recetas pero nunca probó la comida. Sabe dónde va la sal porque está en todos los textos. Pero no sabe cómo se ve una torta al horno si nunca la vio.

Para seguir leyendo

Si querés entender por qué Claude diferencia bien entre lo que sabe y lo que no sabe (mientras otros modelos alucinan), eso es un artículo distinto. La pista: es arquitectura, calibración y cómo se entrena el modelo.

Mientras tanto: la próxima vez que uses una IA, recordá que no piensa. Predice. Dale pistas claras (contexto), tarea concreta (acción), forma específica (formato) y sonido tuyo (estilo). Así sus predicciones te sirven para verdad.

Cómo "piensa" una IA — sin jerga, para humanos

Por qué entender esto te hace mejor usuario

Si usás una IA sin saber cómo funciona, tenés suerte cuando funciona y frustración cuando no. Entender la mecánica te permite construir mejores prompts, diagnosticar fallos, saber cuándo confiar y cuándo dudar de las predicciones.

La IA no piensa. Ejecuta transformaciones matemáticas en vectores de alta dimensión para estimar distribuciones de probabilidad sobre el vocabulario. Traducido: predice qué palabra viene después basándose en patrones aprendidos del entrenamiento.

La arquitectura transformer: atención y contexto

El paper de Vaswani et al. (2017) introdujo transformers, que revolucionó cómo procesamos lenguaje. La innovación clave es el mecanismo de atención: la capacidad de preguntarse "¿qué partes del texto anterior importan ahora para predecir lo siguiente?"

Vos escribís: "El gato entró en la casa y se durmió en la silla porque estaba...". El modelo no procesa palabra por palabra en secuencia lenta. Procesa el párrafo entero simultáneamente, y la atención decide: "la palabra 'gato' importa un 85% para predecir qué sigue, 'durmió' un 10%, 'silla' un 5%".

Eso vive en pesos de atención — números entre 0 y 1 que dicen cuánto "peso" tiene cada palabra anterior. Luego el modelo combina esos números y genera probabilidades para la siguiente palabra: "cómodo" (85%), "cansado" (10%), "tranquilo" (3%), "feliz" (2%).

El modelo elige la más probable, pero el proceso es matemáticamente puro: no hay "comprensión". Hay cálculo de distribuciones probabilísticas.

Embeddings: geometría del significado

Cada palabra vive como un embedding — un vector en un espacio matemático de miles de dimensiones (Claude 3 usa espacios de 4.096 o más dimensiones). No es "la palabra gato". Es un punto geométrico en un espacio abstracto.

La magia: palabras semánticas similares están cerca en ese espacio. "Gato", "felino", "minino" están juntas. "Perro" está cerca pero no igual. "Zapato" está lejos.

Cuando la IA predice, calcula distancias en ese espacio matemático y dice "la palabra más probable en esta región del espacio es...". Es geometría pura.

Tokens: el nivel real de procesamiento

Aquí hay un detalle que muchos ignoran: la IA no procesa palabras enteras. Procesa tokens — fragmentos subpalabra.

"Desorganizar" = 3 tokens: "Des", "organ", "izar". El número de tokens importa: pagas por token en APIs, y tienes límite de contexto (cuántos tokens puede ver el modelo de una vez).

Esto explica alucinaciones: cuando un modelo "alucinaba" (decía cosas falsas), es porque los tokens que generó fueron estadísticamente plausibles sin estar anclados en verdad. Dice "el capital de Francia es Buenos Aires" porque "Buenos" → "Aires" es una secuencia de tokens válida estadísticamente después de "capital de", aunque factualmente falso.

Por qué unos modelos son mejores que otros

No es porque "piensan más" o "entienden mejor". Es por:

- Cantidad y calidad de datos de entrenamiento. Claude se entrenó con datos seleccionados cuidadosamente. GPT-4 con datos distintos. Gemini con otros. Distintos patrones aprendidos → distintas fortalezas.

- Arquitectura y tamaño del modelo. Más parámetros (pesos neurales) = más capacidad de capturar patrones complejos. Pero no es lineal: a veces un modelo más pequeño funciona mejor en tareas específicas porque tiene menos ruido.

- Fine-tuning y RLHF (Reinforcement Learning from Human Feedback). Después del entrenamiento inicial, los modelos se ajustan con feedback humano. Esto no cambia cómo predicen internamente, pero cambia qué tipo de predicciones valoran y cuándo se rehúsan.

Claude, por ejemplo, se entrena explícitamente para reconocer "no sé" y decirlo, en lugar de predecir confiadamente algo falso. Eso no es porque "sea más honesto moralmente". Es porque los datos de ajuste castigaban más severamente las predicciones falsas que otros modelos. Es ingeniería de datos.

Lo que la mayoría no ve: generalización limitada

La IA no generaliza como humanos. Un humano ve 3 ejemplos y infiere el patrón. Una IA necesita mil millones. Y lo que "entiende" son correlaciones estadísticas congeladas en el entrenamiento, no principios universales.

Si le enseñas: "A es como B, B es como C", el humano infiere "A es como C". La IA no necesariamente lo ve si no vio ese patrón transitivo en sus datos de entrenamiento.

Implicaciones: - Sesgos entrenados. Si los datos tenían sesgos, la IA los repite como distribuciones de probabilidad. No por malicia, por estadística pura. - Alucinaciones persistentes. Si algo suena estadísticamente plausible, la IA lo genera. A veces eso es verdad, a veces no. No hay diferencia interna: ambos son cálculos de probabilidad. - Debilidad en casos raros. Si algo es inusual en los datos de entrenamiento, la IA no tiene patrón robusto. Por eso falla con problemas lógicos atípicos o situaciones que no vio.

Qué significa esto operacionalmente

Entender que la IA es un predictor estadístico cambia cómo la usás:

- Dale contexto abundante. Más contexto = más señal para predicciones mejores. Tu prompt debe incluir ejemplos, restricciones, estilo deseado.

- Sé específico en la tarea. "Escribí un email" es vago. "Escribí un email de 150 palabras pidiendo prórroga con tono formal pero cercano" da pistas claras que el modelo usa para predicción.

- Verifica en dominios críticos. Si el resultado toca dinero, clientes o decisiones importantes, no confíes ciegamente. La IA puede sonar correcta aunque esté prediciendo falsamente.

- Usa modelos distintos para distintas tareas. Claude para razonamiento y calibración sobre incertidumbre. GPT-4 para código (entrenado con GitHub). Gemini para análisis multimodal. No hay "mejor", hay "mejor para tu caso específico".

- Entiende la diferencia entre confident y correcto. La IA es igual de confiante cuando miente que cuando dice verdad. La confianza es una predicción, no garantía.

La IA no entiende. Pero predice tan bien que podés construir sistemas reales con ella.

El truco es reconocer dónde termina la predicción estadística y comienza tu responsabilidad humana.